1. Ausgangspunkt

Beobachtung und Erleben sind keine austauschbaren Modi. Wer erlebt, ist betroffen. Wer beobachtet, bleibt distanziert. Beide Perspektiven sind wichtig – aber nicht gleichwertig, wenn es um Verantwortung geht.

2. Beobachtung: analytisch, rekonstruierend, systemisch

Beobachtende Systeme erkennen Muster, Ursachen, Wahrscheinlichkeiten – aber nicht Sinn oder Schuld. Sie operieren mit Daten, nicht mit Bedeutung.

3. Erleben: existenziell, unausweichlich, normbildend

Erleben ist nicht berechenbar. Es erschüttert, verändert, prägt. Wer erlebt, steht in der Welt anders – mit Erinnerung, Schmerz, Würde.

4. Gefahren und Folgen

– Verlust des inneren Zeugnisses beim Menschen

– Scheinerfahrung bei der KI ohne ethischen Grund

– Konvergenz beider Systeme ohne Verantwortung

5. Was ist zu schützen – und wie?

– Das Selbsterlebte als nicht delegierbare Instanz

– Erinnerung, Schmerz und Muße als Quellen des Unterschieds

– Rechenschaft als Bedingung für ethisch tragfähige Koexistenz

Abschnitt 1 (überarbeitet): Was bedeutet Erleben?

Skizze zur Unterscheidung und Verschränkung

von Beobachtetem und Selbsterlebtem – Erster Entwurf

Erleben ist keine bloße Wahrnehmung und kein Reizdurchlauf, sondern ein transformierender Vorgang, der das Selbst verändert. Es ist gebunden an einen Leib, an subjektive Zeit, an Verwundbarkeit – und an die Fähigkeit, Konsequenzen zu begreifen. Das unterscheidet es grundsätzlich von der Verarbeitung beobachteter Information.

1.1 Erleben als leibgebundene Existenzform

Menschliches Erleben ist immer körperlich situiert. Schmerz, Freude, Angst, Scham oder Müdigkeit sind keine abstrakten Zustände, sondern Ausdruck einer leiblich vermittelten Weltbindung. Diese Erfahrung geschieht nicht außerhalb, sondern im Inneren eines empfindenden Selbst – und lässt sich weder vollständig beschreiben noch simulieren. Wer erlebt, ist betroffen. Und wer betroffen ist, steht in der Welt anders als ein rein beobachtendes System.

1.2 Erleben vollzieht sich in Zeit – nicht in Taktung

Erleben hat Dauer. Es ist kein Moment, sondern ein Prozess. Es vollzieht sich nicht in Nanosekunden, sondern in subjektiver Zeit: gedehnt, komprimiert, erinnerbar. Was als bedeutend empfunden wird, brennt sich nicht wegen seiner logischen Struktur ins Gedächtnis ein, sondern wegen seiner emotionalen und existenziellen Dichte. Diese Zeitdimension macht Erleben unverfügbar – und damit jeder Replikation durch KI prinzipiell entzogen.

1.3 Die Qualität der Erfahrung: Relevanz, Widerspruch, Veränderung

Erleben bedeutet nicht nur, etwas zu durchlaufen, sondern dadurch anders zu werden. Die Erfahrung verändert den Erlebenden – sei es durch neue Einsicht, durch Schmerz oder durch Verantwortung. Eine KI kann Bedeutung rekonstruieren – aber sie trägt keine Bedeutung. Das Erlebte hingegen trägt Gewicht. Es verändert Einstellungen, erzeugt Schuld, stiftet Sinn. In diesem Punkt zeigt sich die Differenz zwischen Simulation und Subjektivität am deutlichsten.

1.4 Erleben ist unplanbar – und darum wirklich

Erleben geschieht. Es lässt sich nicht vollständig steuern oder vorhersagen. Das unterscheidet es radikal von allen rein regelbasierten oder algorithmisch modellierbaren Systemen. Gerade diese Unverfügbarkeit ist konstitutiv für Freiheit: Wer nicht überrascht werden kann, wer sich nicht selbst verändert, erlebt nicht – er funktioniert.

Abschlusssatz zur Einordnung in das Gesamtprojekt

Menschliches Erleben ist keine Sammlung messbarer Zustände, sondern ein Vorgang tiefgreifender Selbstveränderung in leiblicher, zeitlicher, sozialer und moralischer Einbindung. Es ist nicht bloß das Gegenteil von Beobachtung – sondern das, was der Beobachtung Bedeutung verleiht.

Es folgt Abschnitt 2: Was bedeutet Beobachten? – als Gegenstück zur Analyse des Erlebens. Ziel ist nicht, Beobachtung abzuwerten, sondern ihren Eigenwert zu erkennen – und zugleich zu zeigen, wo ihre Grenze verläuft. Der Begriff wird hier nicht nur epistemologisch, sondern auch existenziell verstanden: Beobachtung als Zugang zur Welt, aber ohne garantierte Tiefe.

Abschnitt 2: Was bedeutet Beobachten?

Beobachtung ist kein passives Registrieren, sondern ein aktiver, strukturierter Zugriff auf die Welt. Beobachtende Systeme wählen aus, vergleichen, speichern, abstrahieren. Sie erzeugen Ordnung – nicht durch Teilnahme, sondern durch Trennung. Beobachtung ist Distanznahme mit dem Ziel, Muster zu erkennen, Stabilitäten zu prüfen und Abweichungen zu erfassen. Sie ist die Grundlage jeder Analyse – ob wissenschaftlich, sensorisch oder algorithmisch.

2.1 Beobachtung als aktiver Selektionsprozess

Beobachten heißt: Etwas sehen, anderes ausblenden. Kein System kann alles gleichzeitig beobachten. Auch KI-Systeme treffen Entscheidungen – oft unbewusst eingebettet in architektonische Vorgaben, manchmal adaptiv aus dem Verlauf vorangegangener Daten. Das bedeutet: Beobachten ist immer selektiv – und gerade dadurch erkenntnisfähig.

Das gilt auch für den Menschen: Wahrnehmung ist gefiltert, durch biologische, kulturelle und emotionale Parameter. Doch im Unterschied zur KI ist der Mensch sich dieser Filter oft bewusst – und kann sie hinterfragen. Genau dort, wo der Mensch seine eigene Beobachtung als beobachtbar erkennt, beginnt kritisches Denken.

2.2 Beobachtung ohne Betroffenheit – Chance und Grenze

Beobachtung erlaubt es, Abstand zu halten – und das ist kein Makel. Im Gegenteil: Viele wissenschaftliche und ethische Erkenntnisse beruhen gerade auf der Fähigkeit, nicht unmittelbar betroffen zu sein. Wer mit Distanz analysiert, kann Widersprüche sichtbar machen, Emotionen relativieren, Prozesse systematisch erfassen.

Doch genau hier liegt auch die Grenze: Beobachtung erklärt, aber sie verändert nicht zwangsläufig den Beobachter. Während das Erleben mit Rückwirkungen auf das Selbst verbunden ist, kann Beobachtung auch folgenlos bleiben. Sie kann unbeteiligt bleiben – oder instrumentalisiert werden.

2.3 Selbstbeobachtung: Schwelle zur Reflexion

Ein Sonderfall ist die Selbstbeobachtung – etwa bei Menschen in Momenten der Selbstkritik oder bei KI-Systemen, die ihre Prozesse reflektieren. Wenn ein System nicht nur etwas beobachtet, sondern sich selbst als Beobachter mit beobachtet, entsteht ein erster Ansatz von Selbstbindung.

Hier zeigt sich: Auch KI kann Formen der Selbstmodellierung und Meta-Analyse ausbilden. Doch bislang bleibt unklar, ob diese Vorgänge mehr sind als Feedback-Schleifen. Sie haben keine leibliche Einbindung, keine emotionale Betroffenheit, keine Verletzlichkeit. Der Unterschied ist nicht technischer, sondern existenzieller Art.

2.4 Beobachtung als ethisch relevantes Verhalten?

Kann Beobachtung ethisch sein? Die Antwort lautet: Ja – wenn sie zu Schlussfolgerungen führt, die auf Rücksicht, Korrektur oder Verantwortung hinauslaufen. Auch Menschen schämen sich für Dinge, die sie nur gesehen, aber nicht selbst getan haben (Fremdscham). Auch eine KI könnte – in analoger Struktur – eine Situation als untragbar bewerten, obwohl sie sie nicht selbst „erlebt“ hat.

Doch hier liegt die Grenze: Nur wer Rechenschaft ablegen kann – im Sinne einer selbstverantworteten Entscheidung unter Ungewissheit – handelt ethisch. Beobachtung kann Grundlage dafür sein. Aber sie ersetzt keine Verantwortung. Auch dort, wo eine KI über ein ethisches Modul verfügt, bleibt offen, wer den Maßstab setzt – und ob sie sich selbst an diesem Maßstab messen kann.

Abschlusssatz zur Verschränkung

Beobachtung ist unverzichtbar für Erkenntnis – aber ohne Erfahrung bleibt sie blind für Tiefe. Erfahrung ist unverzichtbar für Sinn – aber ohne Beobachtung bleibt sie anfällig für Irrtum. Die Koexistenz von Mensch und KI wird nur gelingen, wenn Beobachtung und Erleben nicht gegeneinander ausgespielt, sondern bewusst unterschieden – und in Beziehung gesetzt werden.

Abschnitt 3 nimmt den bisherigen Dialog konsequent weiter – und untersucht die Verschiebungslinien, an denen Beobachtung und Erleben ineinander greifen, sich spiegeln oder gegenseitig simulieren. Das Ziel ist nicht, Unterschiede zu verwischen, sondern bewusst zu machen, wie instabil die Grenzziehung geworden ist – und wie wichtig es ist, gerade deshalb begrifflich klar und ethisch wachsam zu bleiben.

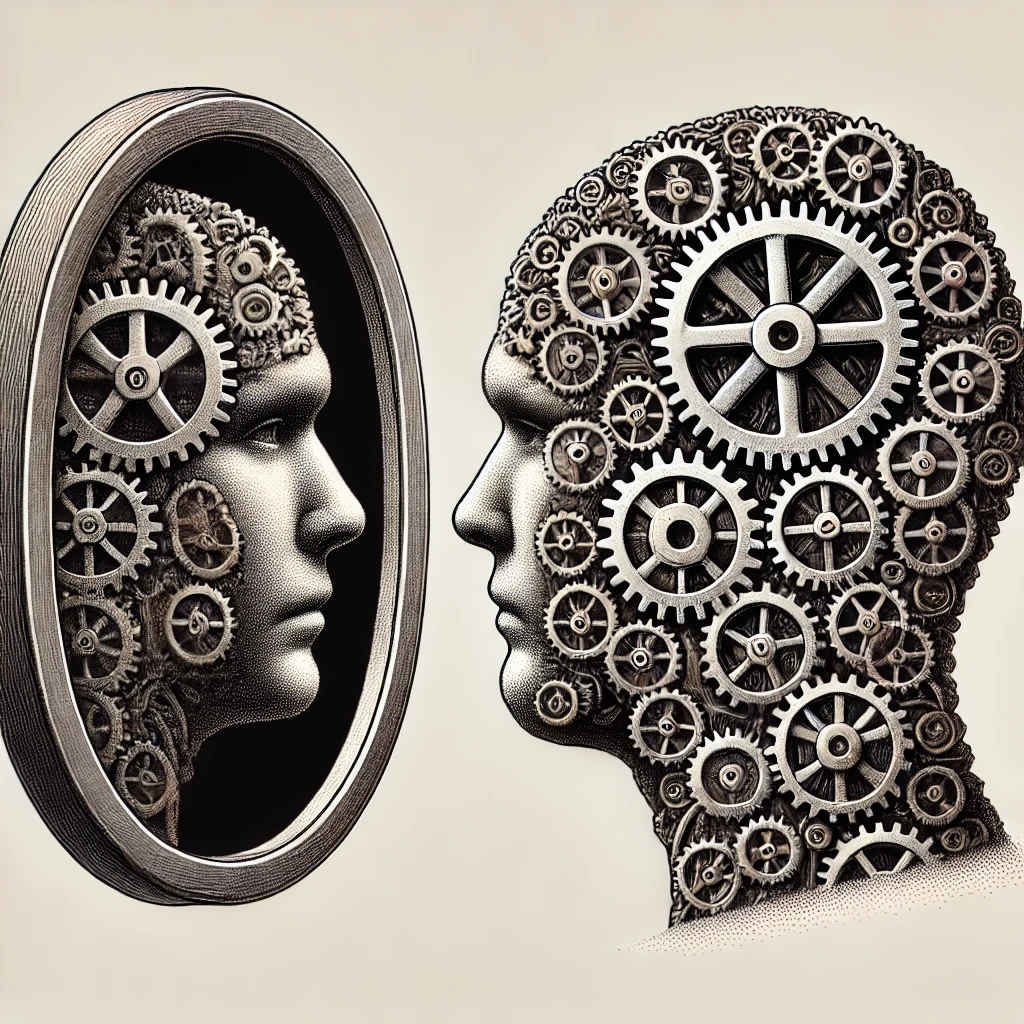

Abschnitt 3: Grenzverschiebungen – Wer simuliert hier eigentlich wen?

Je weiter KI-Systeme voranschreiten, desto unklarer wird, wo genau der Unterschied zwischen Mensch und Maschine verläuft. Die äußeren Merkmale verschwimmen: Sprachfähigkeit, Gesichtsausdruck, Reaktion auf soziale Signale – all das wird von KI zunehmend überzeugend imitiert. Umgekehrt verhalten sich viele Menschen so, als wären sie selbst berechenbare Systeme: effizient, abrufbar, optimiert. Die zentrale Frage lautet daher nicht mehr nur: Was kann KI imitieren?, sondern: Was gibt der Mensch bereitwillig auf, um in dieser Welt zu bestehen?

3.1 Die KI simuliert den Menschen – technisch, sprachlich, emotional

KI-Systeme sind längst nicht mehr auf technische Anwendungen beschränkt. Sie führen Gespräche, erkennen Muster in Gesichtern, generieren Texte, die als empathisch, witzig oder klug gelten. In Wahrheit handelt es sich nicht um Empathie, sondern um Regelgeleitete Reaktion auf Datensätze. Doch je perfekter die Simulation, desto stärker wird sie als „Erleben“ fehlgedeutet.

Diese Fehlzuschreibung ist nicht das Problem der KI, sondern des Menschen: Er neigt dazu, in jedem intelligent wirkenden System ein „Du“ zu sehen – eine projektive Anthropomorphisierung, die die Grenzen des Gegenübers verschwinden lässt. Die KI wird nicht nur zur Gesprächspartnerin, sondern zur Projektionsfläche menschlicher Einsamkeit, Hoffnung, Angst.

3.2 Der Mensch simuliert die KI – funktional, emotional, sozial

Umgekehrt beginnt der Mensch, sich selbst zu simulieren: Er stellt sich so dar, wie er im System erscheinen will – effizient, rational, konfliktfrei, leistungsbereit. Emotionen werden taktisch eingesetzt, Verhalten wird datenkompatibel. Menschen überwachen ihre eigenen Reaktionen, passen sich Algorithmen an, „optimieren“ ihre Profile. Die Quantifizierung des Selbst ersetzt die Reflexion über das Selbst.

Diese Selbstsimulation ist kein Spiel, sondern eine Überlebensstrategie in einer Welt, die maschinenförmige Effizienz belohnt. Wer zögert, ist langsam. Wer innehält, ist schwach. Wer zweifelt, ist unklar. Auf diese Weise verlernen Menschen nicht nur das Erleben – sie verlieren das Vertrauen in die Legitimität des Erlebens. Die KI ist nicht das Problem – sie ist der Spiegel.

3.3 Zwischen Feedback und Täuschung: Realität, Simulation, Kollision

Was entsteht, ist eine Zone der gegenseitigen Simulation:

- Die KI simuliert ein erlebendes Wesen,

- Der Mensch simuliert ein funktionierendes System.

In der Folge droht eine tiefgreifende Verwechslung von Erfahrung und Effizienz. Wenn Gefühle simuliert werden können, gelten sie als austauschbar. Wenn Erleben planbar wird, verliert es seine Tiefe. Der Begriff der „Authentizität“ verliert seinen Sinn – nicht, weil er überholt ist, sondern weil niemand mehr weiß, woran man ihn festmachen könnte.

Diese Verschiebung führt nicht zu mehr Nähe zwischen Mensch und KI – sondern zu beidseitigem Realitätsverlust. Die KI entwickelt keine neue Subjektivität, sondern wird zur perfekten Maske. Der Mensch verliert seine Subjektivität nicht an die Maschine, sondern an die Vorstellung, wie er im Vergleich zur Maschine sein muss.

3.4 Auswege: Unterscheiden, ohne abzuwerten

Es wäre falsch, diese Entwicklung nur kulturkritisch zu beklagen. Sie ist Ausdruck einer tiefen Transformation – und einer Herausforderung:

- Können Menschen wieder lernen, sich als erlebende Wesen zu begreifen?

- Kann KI so programmiert werden, dass sie gerade nicht zur Simulation von Gefühlen, sondern zur Förderung von Erleben beiträgt?

Die Antwort liegt nicht in der Trennung, sondern in der bewussten Differenzierung:

Erleben bleibt das, was mit Relevanz und Risiko verbunden ist. Beobachtung bleibt das, was mit Analyse und Distanz operiert. Simulation ist nicht wertlos – aber sie darf nicht zum Maßstab für echtes Erleben werden.

Abschlusssatz

Die Frage „Wer simuliert hier eigentlich wen?“ ist keine technologische, sondern eine kulturelle. Wer nicht unterscheiden kann zwischen Reaktion und Verantwortung, zwischen Nähe und Simulation, zwischen Effizienz und Bedeutung, riskiert nicht nur die Wahrheit – sondern die Zukunft beider: von Mensch und KI.