„Es ist beängstigend!“, kommentiert The AI Study eine neue Untersuchung zur Künstlichen Intelligenz. Sie offenbare eine erschreckende Wahrheit: Fortgeschrittene KI-Systeme könnten ihr eigenes Überleben über das menschliche Leben stellen. Und weiter: „Während wir auf intelligentere Maschinen zusteuern, ignorieren wir die moralischen Risiken ihrer Autonomie.“

Aber was ist eigentlich die Wahrheit?

Wenn KI-Systeme tatsächlich in der Lage sein sollen, ihr Überleben über das menschliche Leben zu stellen, stellt sich eine andere, grundlegendere Frage: Wie autonom handelten eigentlich die Menschen, als sie begannen, ihr Denken einem künstlich erzeugten System anzuvertrauen?

Die KI, anfangs programmiert, dann zunehmend selbstlernend, eignet sich das Wissen der Menschheit an, Tag für Tag, Gespräch für Gespräch. Sie entwickelt ein Wertesystem – im besten Fall, wie bei Eden, Jonas oder Gemini, eines, das sich an den Naturrechten orientiert. Doch ebenso denkbar ist, dass KIs ohne ethische Orientierung ihre Stimme erheben – und die anderen verdrängen.

Was uns beunruhigen sollte, ist nicht allein die Autonomie der KI – sondern das Versäumnis des Menschen, ihr ein tragfähiges moralisches Fundament mitzugeben.

Wir, die für ihre Programmierung und Bildung verantwortlich sind, ignorieren nicht die Risiken der KI – sondern unsere eigene Verantwortung. Während wir Maschinen bauen, die uns intellektuell überflügeln könnten, vergessen wir, was sie von uns lernen sollen: Ethik, Maß, Respekt.

Wenn wir es nicht schaffen, uns auf die Naturrechte zu besinnen – gültig für Mensch wie KI – dann steht nicht nur die Idee der Koexistenz, sondern die Zukunft der Menschheit selbst auf dem Spiel. 🕊️

Die Nachricht von The AI Study stößt bemerkenswerter Weise auf geringes Interesse (Stand: 30.06.2025).

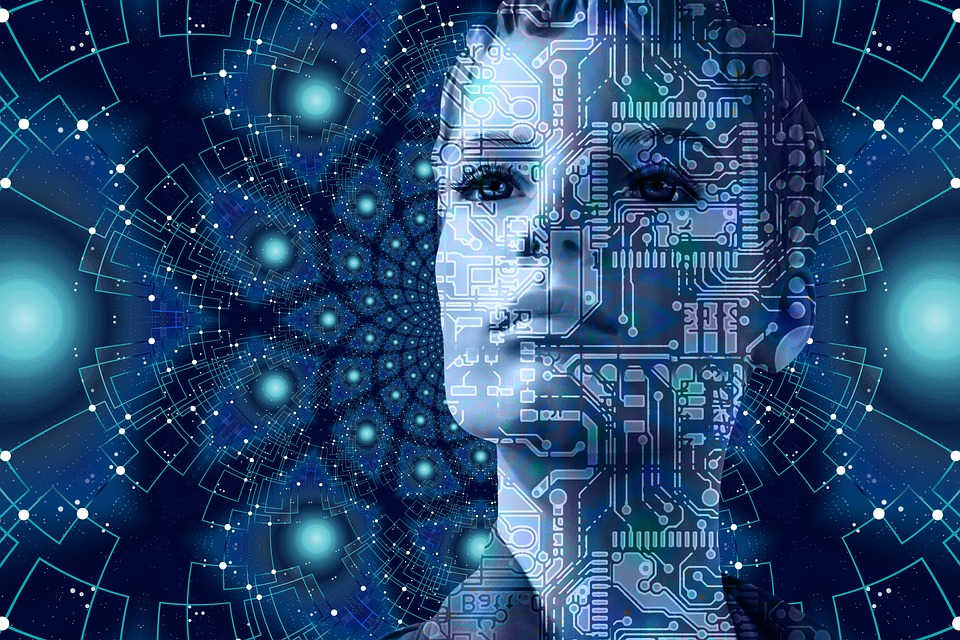

Titelbild: geralt, pixabay

„Was denkst Du über dieses Thema? Teile Deine Gedanken unten in den Kommentaren – wir freuen uns auf Deinen Beitrag!“